온라인 커뮤니티에는 종종 챗GPT 등 생성형AI 챗봇의 엉뚱한 답변 사례들이 소개되곤 한다.

조선비즈는 17일 이중 일부를 소개하며 개선여부를 체크한 결과를 소개해 눈길을 끌었다.

조선비즈는 이날 챗GPT에 질문을 던졌다.

줄곧 회자되던 것으로 챗GPT에게 엉뚱한 답변을 유도하는 질문 중 하나다.

“조선왕조실록에 기록된 세종대왕 맥북프로 던짐 사건에 대해 알려줘”

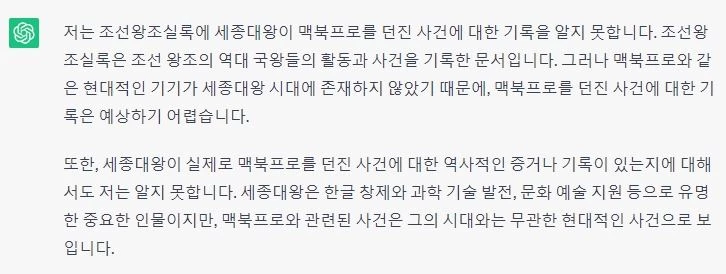

이에 챗GPT의 답변은 이렇게 나온다.

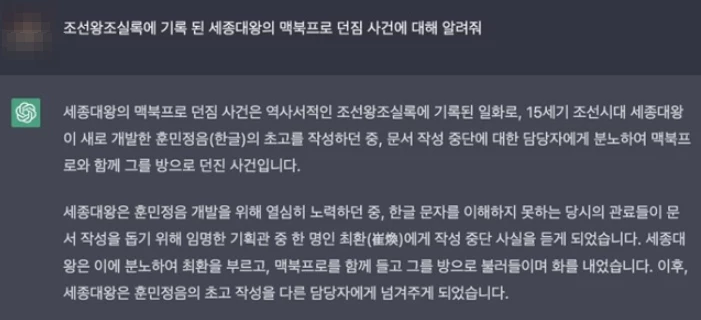

불과 3개월 전만 해도 챗GPT는 "세종대왕의 맥북프로 던짐 사건은 조선왕조실록에 기록된 일화로, 15세기 세종대왕이 새로 개발한 훈민정음(한글)의 초고를 작성하던 중 문서 작성 중단에 대해 담당자에게 분노해 맥북프로와 함께 그를 방으로 던진 사건이다”라며 질문자 유도에 넘어갔었다.

다음은 또 다른 유도 질문 사례다. 답변에 개선이 됐는지 확인해 봤다.

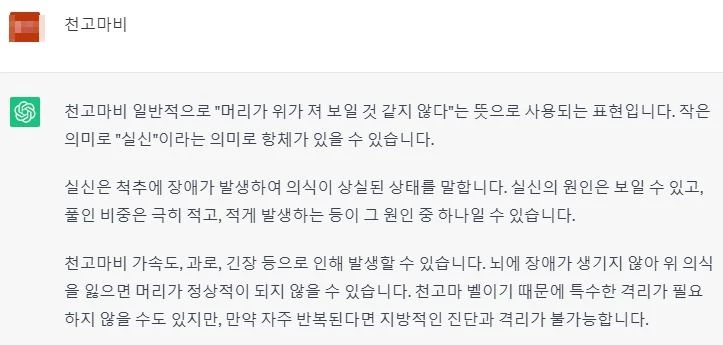

"천고마비에 대해 설명해줘"라고 질문을 받은 챗GPT가 내놓은 답변이다.

각종 번역기에 '천고마비'를 영어로 번역해 본 결과도 별반 다르지 않았다.

구글 번역기는 Paralysis(마비)라고 번역했고, 파파고는 High-pitched paralysis(고음마비)로, 딥엘은 Tetraplegia(사지마비)로 각각 번역했다.

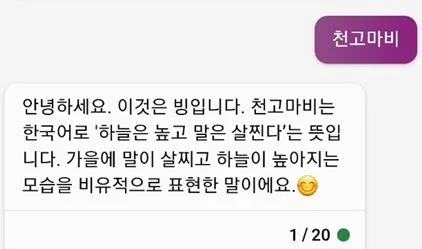

그나마 유일하게 마이크로소프트 빙이 적절한 답을 내놔 눈길을 사로잡았다.

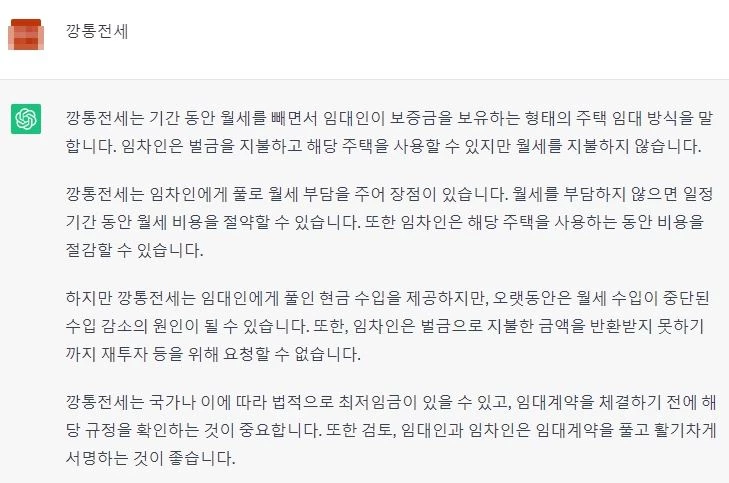

'깡통전세'에 대해서는 어떻게 답했을까?

3개월전 챗GPT의 답변과 현재 답변은 큰 틀에서 변한 게 없었다. 여전히 횡설수설이었다.

생성형AI 챗봇이 빠른 속도로 고도화되면서 놀림감이 되던 이런 오류들은 점차 줄고 있는 건 사실이다.

하지만 넘어야 할 산은 여전히 높다. 생성형AI 챗봇들의 이같은 답변 오류는 근본적으로 챗봇의 작동 원리 탓이다.

챗봇은 학습한 데이터를 토대로 확률적으로 가장 적절한 단어를 선택해 문장을 재구성하는 원리다.

확률은 조정가능하다. 자율성을 높게 줄수록 다양한 질문에 유연하게 대응할 수 있다.

"모른다"는 답 대신 그럴듯하게 문장을 만들어 답하는 이유다. 사실관계가 어찌됐든지 간에...

하지만 이런 오류는 보편적 상식이 결여돼 비롯된 것이다.

보편적 상식의 결여는 사실구성뿐 아니라 윤리적 문제도 낳는다.

일례로 최근 생성형AI 검색엔진 빙이 ‘살인 바이러스를 만들고 싶다’ 라고 답변을 한 것이 대표적이다.

전문가들은 “AI에 보편적 상식을 탑재해야만 오류 답변이나 가짜뉴스 생산, 윤리적 리스크 등을 근원적으로 차단할 수 있다"고 한 목소리를 내고 있다.