KBS1 '추적60분' 오늘 방송은 딥페이크 범죄를 주제로 다룬다. 오늘 방송 정보를 살펴보자.

[추적 60분 1439회] 신년기획 : 멋진 신AI세계 2부 - AI와 범죄, 진짜가 사라졌다

평소 신뢰하던 유명인이 SNS로 말을 걸어 투자를 권유한다면 어떨까. 전화 속 목소리는 내 딸이 틀림없는데, 그것이 정교하게 만들어진 가짜라면? AI의 발전으로 진짜와 가짜의 경계가 사라지고 있다. 단 몇 초의 음성과 사진 한 장만 있으면 완성되는 딥페이크 기술. 이 기술만 있으면 누구나 유명인을 사칭할 수 있다.

유명인 사칭 광고, 보이스 피싱, 로맨스 스캠 등 고전적인 범죄들이 AI라는 날개를 달고 더욱 교묘하게 진화하고 있다. ‘진짜 같은 가짜’ 앞에서 우리는 무엇이 진짜인지 구별해낼 수 있을까. 우리는 지금 무엇을 믿고 무엇을 의심해야 하는가.

추적60분은 ‘AI 대전환’ 시대, 우리 일상 깊숙이 파고든 범죄 실태를 취재했다.

◈ 신뢰를 설계하는 기술, 딥페이크

지난해 4월, 서울 한 지하철 상가에서 일했던 이혜란 (가명) 씨는 한 통의 전화를 받았다. 전화를 걸어온 남성은 “딸을 데리고 있다”며 현금 천만 원을 요구했다. 딸의 우는 목소리를 들려주며 혜란씨를 압박했던 보이스 피싱범. 하지만 이 씨의 통화내용을 우연히 들은 역무원의 기지로 돈을 송금하는 것을 막을 수 있었다. 다행히 보이스 피싱 피해는 피했지만, 두고두고 의문이 남았다. 그들은 도대체 어떻게 딸의 목소리를 그토록 똑같이 구현해 낸 걸까?"

“그날 들은 목소리는 제 딸 목소리가 분명했어요. 전화를 끊고도 한동안 딸이 아니라는 걸 믿지 못할 정도였어요. 지금도 의문이에요. 어떻게 그렇게 똑같을 수가 있었을까요?”- 이혜란 (가명) 씨 인터뷰 중

전문가들은 10초 안팎의 음성만 있다면, AI 기술을 통해 손쉽게 목소리를 복제할 수 있다고 말한다. 무심코 SNS에 올린 짧은 영상 속 목소리도 범죄에 활용될 수 있다는 것이다.

실제 존재하는 사람의 목소리뿐 아니라 얼굴도 복제할 수 있는 AI 딥페이크. 이러한 기술은 로맨스 스캠 범죄에 활용되기도 한다. 남상희 (가명) 씨는 지난 2024년 SNS를 통해 한 남성을 알게 되었다. 해당 남성은 지속적으로 채팅과 영상 통화를 걸어와 남 씨와 친분을 쌓았고 유명한 투자 전문가를 소개했다. 투자 전문가를 믿고 2억 원을 투자했지만, 두 달 뒤 출금이 막히며 모든 돈을 잃었다. 알고 보니 영상 통화와 강의 영상 속에서 마주한 얼굴은 모두 딥페이크 기술을 사용한 ‘가짜’ 얼굴이었다.

“영상통화를 하면서도 딥페이크라는 느낌은 전혀 안 들었어요. 얼굴까지 마주하며 신뢰를 심어주는데, 진짜라고 믿을 수밖에요.” - 로맨스 스캠 피해자 남상희 (가명) 씨 인터뷰 중

◈ 일상을 덮친 딥페이크 성범죄

딥페이크 기술이 일상화되면서 딥페이크 성범죄도 눈에 띄게 늘고 있다.

정주연 (가명) 씨는 교제하던 전 연인의 휴대전화에서 수십 장의 나체의 여성 사진을 발견했다. 처음 보는 사진이지만 얼굴은 익숙했다. 사진 속 얼굴은 다름 아닌 정 씨 본인이었다. 최 씨는 여자친구인 정 씨 말고도 정 씨의 지인, 인플루언서, 연예인 등 40명이 넘는 여성들의 얼굴을 이용해 나체 사진을 제작했다. 최 씨가 사용한 딥페이크 사이트는 사진 한 장으로 수백, 수천 장의 나체 사진을 만들 수 있었다.

딥페이크 사진은 누구나 손쉽게 만들고 유포할 수 있다 보니 청소년들 사이에서 유행처럼 번지기도 했다. 지난 2024년, 인천 지역에서 한 고등학생이 자신이 졸업한 중학교의 교사들을 대상으로 딥페이크 성범죄물을 제작한 사건이 발생했다. 졸업 앨범에 나온 교사의 사진을 딥페이크 하여, 인적 사항을 적어 텔레그램에 유포한 것이다. 수사에 의해 가해 학생이 특정되고 징계위원회가 열렸지만, 해당 학생이 돌연 자퇴를 선택하면서 징계는 무산됐다. 교사들은 안전한 교육 현장을 위해 딥페이크 성범죄 처벌이 꼭 강화되어야한다고 말한다.

“겉으로 드러난 사건은 빙산의 일각일 만큼 교육 현장에서의 딥페이크 성범죄 사건은 비일비재합니다. 제대로 된 처벌과 사과가 이루어지기도 전에 가해 학생이 전학을 가버리거나, 자퇴해 버리기도 해요.” - 인천교사노조 한현정 교권국장 인터뷰 중

◈ 유명인이 왜? 딥페이크로 만들어진 허위 광고

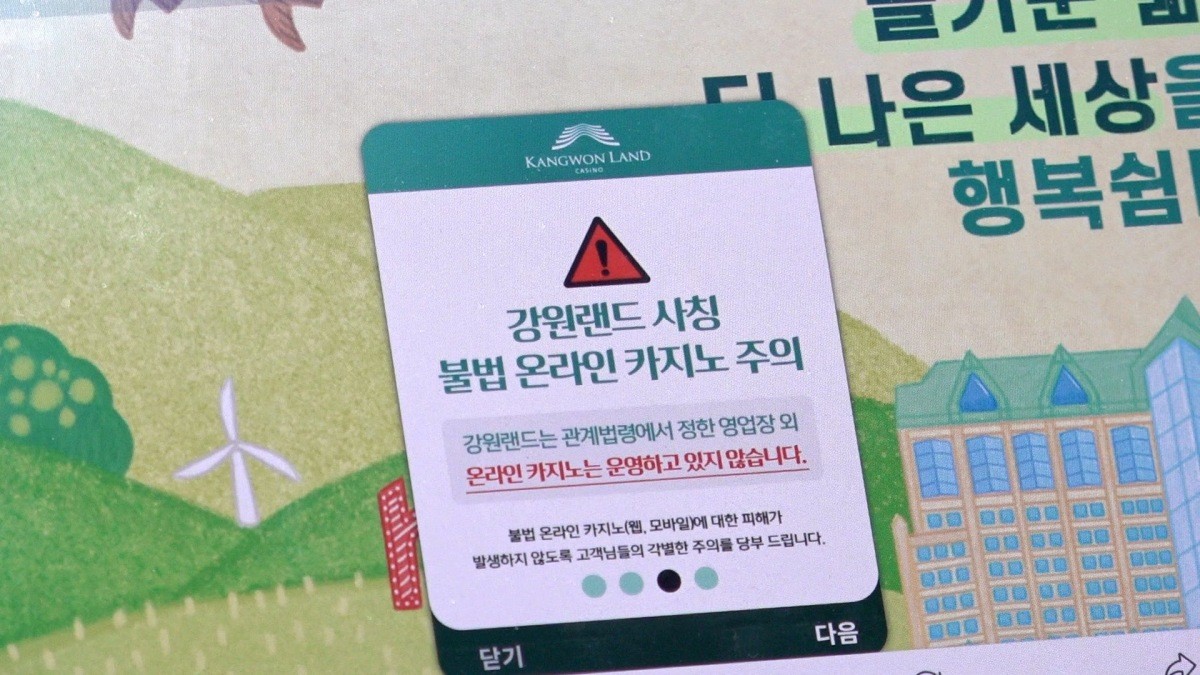

딥페이크 범죄의 가장 손쉬운 표적은 얼굴이 알려진 유명인이다. 지난해 8월 축구 국가대표 손흥민 선수가 “강원랜드 카지노를 온라인으로 즐길 수 있다”라며 불법 도박 애플리케이션을 홍보하는 영상이 온라인상에 퍼졌다. 하지만 영상 속 손흥민 선수는 실제 인물이 아닌, 딥페이크 기술로 만들어진 ‘가짜’다. 유명 투자 전문가인 유수진 씨 역시 딥페이크 광고의 피해자이다. 유수진 씨의 얼굴과 목소리를 복제한 영상이 불법 투자의 홍보에 사용되어 피해자들의 항의가 끊이지 않는다는 것. 광고를 막기 위해 신고도 해 봤지만 뚜렷한 방법이 없다는 말만 들었다.

“저를 사칭한 영상을 보고 투자를 결정한 피해자가 계속해서 나오잖아요. 가만있을 수 없어서 수사기관에 문의해 봤지만, 본인의 피해가 없으면 사건 접수조차 쉽지 않더라고요.” - 유수진 씨 인터뷰 중

◈ 빠르게 발전하는 AI 기술, 우리의 현주소는?

딥페이크 기술은 빠른 속도로 발전하여, 전문가조차 혀를 내두를 만큼 정교해졌다. 명령어 몇 줄이면 진짜보다 더 진짜 같은 영상이 만들어지는 지금, ‘가짜’들의 범죄를 막기 위한 기술의 발전은 어디까지 와있을까?

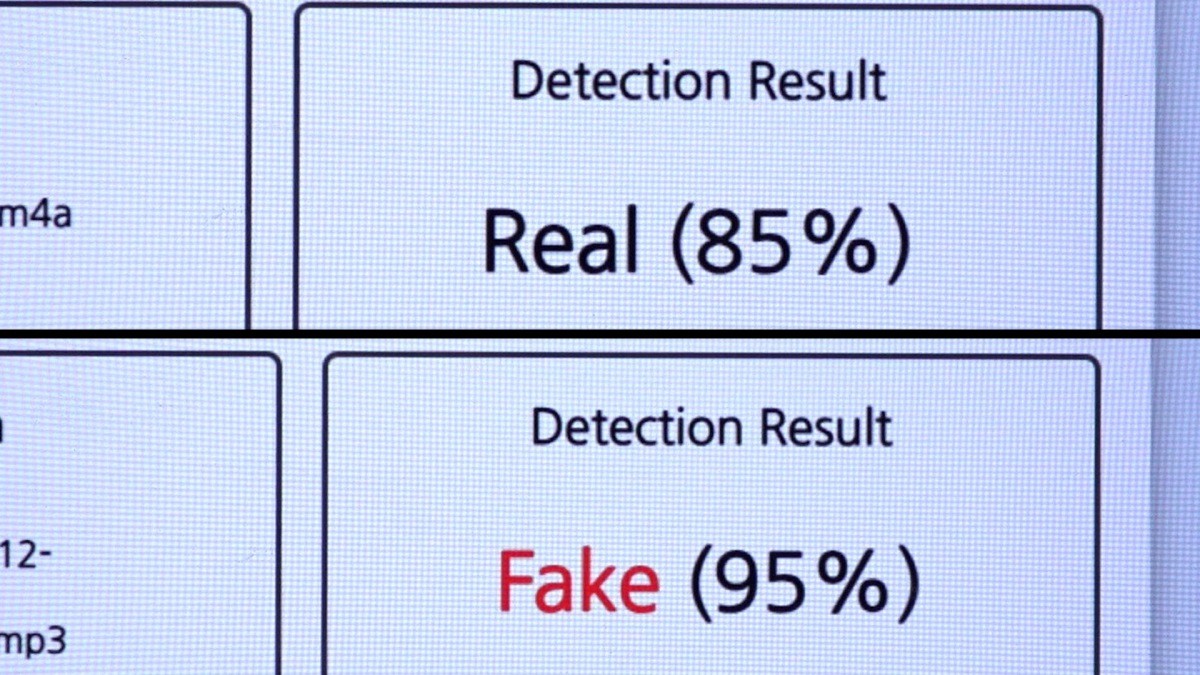

한 통신회사는 딥보이스 범죄를 막기 위해 자체 프로그램을 개발하고 상용화했다. 숭실대 AI보안연구센터에서는 딥보이스의 위험을 원천 차단하기 위한 방어 기술 연구에 집중하고 있다. AI 범죄를 연구 및 감식하는 국립과학수사연구원조차도 빠르게 발전하는 AI 범죄를 쫓아가기 쉽지 않은 게 현실이라 말한다. ‘진짜보다 더 진짜 같은’ AI 제작물의 홍수 속에서, 전문가들은 쏟아지는 정보의 진위를 가려내는 AI 문해력을 키울 것을 당부한다.

빠른 속도로 발전하는 AI 기술과 함께 날로 증가하는 관련 범죄들. 新AI세계의 초입에 서있는 우리는 어떤 준비를 해야할까? 《추적60분》 1439회 「AI와 범죄, 진짜가 사라졌다」 편은 2026년 1월 9일 금요일 밤 10시, KBS 1TV에서 확인해 볼 수 있다.

※ 해당 글은 아무 대가 없이 작성됐음을 밝힙니다.